Article publié dans le Mag RH n°30.

L’intelligence artificielle (IA) s’impose progressivement dans les pratiques des ressources humaines (RH), facilitant, par exemple, le recrutement, la gestion des talents et l’automatisation de nombreuses tâches.

Toutefois, son utilisation ne doit pas occulter les responsabilités des professionnels RH. Deux principes fondamentaux doivent guider cette transformation : l’exercice d’un esprit critique face aux outils d’IA et l’appropriation de la responsabilité des décisions prises, même lorsqu’elles sont assistées par une ou des intelligences artificielles

L’impératif de l’esprit critique

L’IA n’est pas infaillible. Ses algorithmes, bien que performants, restent influencés par la qualité des données sur lesquelles ils sont entraînés, les biais potentiels des modèleset les limites inhérentes à leur conception.

Dans un contexte RH, cela peut se traduire par des recommandations biaisées dans le recrutement, l’évaluation des performances ou la gestion de carrières.

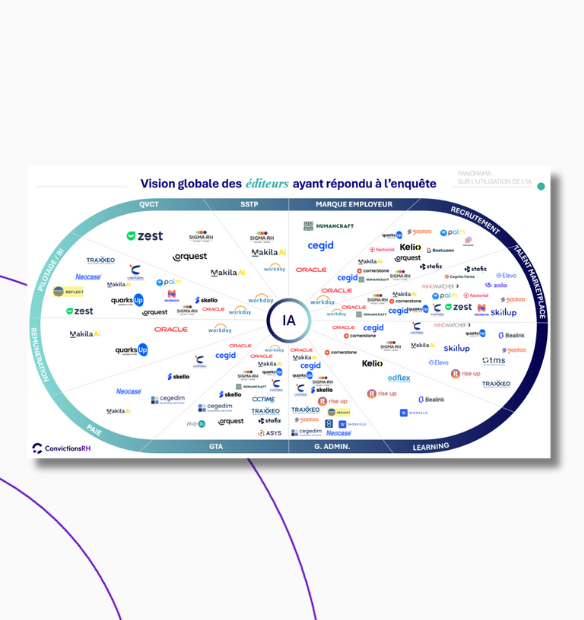

Les acteurs de l’écosystème SIRH ne s’y trompent pas. Selon notre Panorama IA & SIRH publié en avril 2025, les éditeurs de solutions identifient « les enjeux éthiques des biais algorithmiques» comme le principal frein à l’implémentation de l’IA chez leurs clients RH.

L’acculturation permanente à l’IA, l’information et les formations qui en découlent constituent aujourd’hui des garde-fous indispensables.Le RH ne doit jamais baisser la garde : chaque donnée produite par l’IA représente une richesse supplémentaire, mais aussi, potentiellement, une source de négligence.

L’article 22 du Règlement Général sur la Protection des Données (RGPD) impose une vigilance particulière à l’égard des décisions exclusivement automatisées. Il garantit aux individus le droit de ne pas faire l’objet d’une décision fondée uniquement sur un traitement automatisé produisant des effets juridiques ou significatifs les concernant. En d’autres termes, aucune décision importante ne devrait être prise sans intervention humaine. Les professionnels RH doivent donc adopter une posture critique et questionner les recommandations de l’IA.

Cela implique notamment de :

- Vérifier les sources et les données utilisées par l’IA, afin de s’assurer de leur pertinence et de leur neutralité. Par exemple, 65 % des solutions de recrutement intègrent la génération automatique de descriptions de poste et de contenu pour les annonces (source : Panorama IA & SIRH de ConvictionsRH). Malgré un gain de temps évident et des résultats déjà probants, la vérification reste essentielle : elle conditionne la complétude et la cohérence de l’offre. Dans le cas contraire, les risques sont multiples — erreur sur la rémunération, le site, l’intitulé, l’activité — et les conséquences potentiellement coûteuses : allongement des délais, perte de candidats et dégradation de la marque employeur

- Croiser les analyses IA avec des observations humaines pour contextualiser et affiner les recommandations. Ainsi, 59 % des solutions se positionnent sur l’identification des profils les plus pertinents. Mais dans un marché concurrentiel, les outils sont-ils suffisamment matures, constants et fiables pour nous dispenser de chercher, nousmêmes, la pépite cachée au fond de la pile de CV ?

- Développer une culture de l’audit des outils IA, en s’assurant que les modèles utilisés sont compréhensibles et explicables.

se prémunir contre les biais d’usage… avant même de se confronter à ceux de l’IA.

L’engagement dans la responsabilité des décisions RH

L’IA peut fournir des résultats à la fois rapides et précis, mais la responsabilité finale incombe toujours aux décideurs humains. Si l’on reprend l’exemple du recrutement un des domaines RH les plus sollicités par l’IA , il est essentiel de connaître l’article L1221-8 du Code du travail, qui stipule que les méthodes et techniques d’aide au recrutement ou d’évaluation des candidats doivent être pertinentes au regard de la finalité poursuivie. Bien que cet article ne mentionne pas explicitement l’obligation d’une intervention humaine, il implique clairement que les outils utilisés doivent être appropriés et ne doivent pas conduire à des décisions discriminatoires ou injustes.

Ainsi, les acteurs RH doivent :

- Assumer la propriété de leurs écrits et décisions : même lorsqu’un texte, une analyse ou une recommandation est généré par l’IA, il est indispensable de le challenger, l’adapter et en vérifier la conformité avec les principes de l’entreprise et la réglementation. C’est un constat aussi flagrant que préoccupant : la vulgarisation des usages de l’IA notamment via les assistants conversationnels basés sur des IA génératives dans une société toujours plus pressée et avide de résultats, engendre des situations dérangeantes, voire malsaines, où l’utilisateur n’est parfois ni en mesure d’expliquer, ni d’assumer ses propres propos. Ce phénomène touche particulièrement les jeunes professionnels RH, qui pourraient pourtant progresser plus rapidement sur certaines tâches à condition d’en maîtriser les enjeux et les mécanismes.

- Garantir la transparence des processus décisionnels : les collaborateurs ou candidats doivent comprendre comment l’IA est mobilisée dans leur gestion professionnelle et être en capacité de contester une décision. À l’automne 2024, Yann Ferguson, docteur en sociologie à l’Inria et directeur scientifique du LaborIA, nous rappelait que «les professionnels RH devront constamment adapter leurs pratiques au fur et à mesure que l’IA évolue». Cet enjeu permanent et de plus en plus rapide d’adaptation, au service de l’explicabilité et de la transparence, est au cœur de processus décisionnels responsables.

- Encadrer «juridiquement» l’utilisation de l’IA dans les processus RH : il s’agit d’intégrer des clauses de transparence, de validation humaine et de nondiscrimination dans les politiques internes. Si nos directions doivent s’adapter, nos lois aussi. Pourtant, dans cette course déjà engagée, il est évident que le législateur ne pourra rivaliser avec la vélocité de l’IA et de ses mutations. C’est donc aux directions, aux RH, aux acteurs internes de mener cette course avec leurs propres armes «juridiques». On voit déjà émerger, progressivement, des règlements, des chartes, mais aussi des outils internes plus ou moins avancés ayant vocation à cadrer et encadrer les usages.

Les décisions doivent toujours rester entre les mains du professionnel RH. Pourtant, la tentation est grande de se reposer sur une recommandation préformulée par un assistant artificiellement intelligent. Ce n’est que par une politique RH adaptée, un management responsable, et des processus circonstanciés, que nos professionnels resteront pleinement maîtres de leurs décisions.

Chaque mois recevez un éclairage sur les dernières tendances RH !

Et quelle gouvernance de l’IA ?

Sous un autre angle. Le RH face à l’IA dans son entreprise. Loin d’être une réponse purement technique ou réglementaire, la question de la décision en contexte IA engage une nouvelle gouvernance au sein des organisations. Nos accompagnements en RH et transformation sont désormais traversés par cette dimension inédite. Si les professionnels RH sont en première ligne pour faire vivre les processus et les outils associés, ils ne peuvent être les seuls acteurs.

Yann Ferguson nous le rappelle : « Cette technologie s’est d’abord imposée auprès du grand public ; en s’emparant de ces outils, une part importante des collaborateurs ont commencé à intégrer spontanément l’IA dans leur quotidien professionnel, souvent sans directive explicite de la part de leurs employeurs.»

Alors forcément, décider, dans un environnement IA, devient un exercice collectif, encadré et distribué, qui appelle à une répartition claire des rôles. Les équipes RH, les directions générales, les équipes juridiques, les équipes informatiques : tous ont une mission, et chacun doit assumer un rôle stratégique, moral, technique ou d’accompagnement.

Les collaborateurs eux-mêmes doivent se former, s’informer, s’impliquer dans l’usage de ces outils. L’acceptabilité sociale et professionnelle de l’IA notamment dans des décisions sensibles comme une promotion, une rémunération ou une mobilité repose sur la confiance. Et cette confiance naît d’une culture du dialogue, de l’explication et de la transparence.

Là encore, il s’agit d’humain. Le RH est au centre de cette évolution du monde professionnel. Le RH est acteur. Le RH est engagé. Le RH est critique. Le RH est responsable. Le RH est décideur.

Si les feuilles de route IA RH s’installent encore timidement dans les organisations, nous observons néanmoins une volonté réelle de bonifier les processus RH et, surtout, d’acculturer et de former les équipes RH et managériales à l’usage de l’intelligence artificielle.

C’est dans ce contexte et en fonction du niveau de maturité de chaque organisation et de chaque service RH vis-à-vis de l’IA que nous réaffirmons nos convictions : chaque acteur RH, utilisateur d’une IA, doit conserver son esprit critique et demeure responsable de ses actes. Plus que jamais, les RH doivent être moteurs dans la mise en place d’une gouvernance de l’IA au sein de leur organisation.

Cet article a été écrit avec l’assistance de l’IA et de mon esprit critique, et j’en assume l’entière responsabilité.